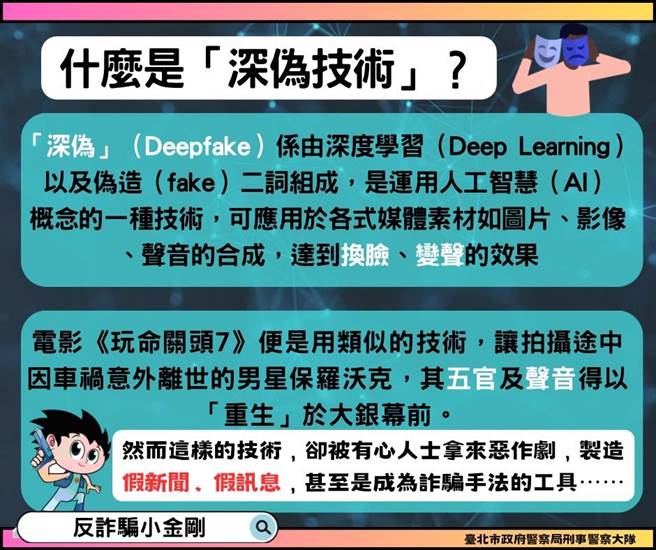

一切都是假的!网红小玉日前传出接受客制,将名人的脸以电脑技术替换入谜片,藉此获利千万,一审遭判刑5年6个月,对此警方指出,这种名为「深偽(Deepfake)」的技术应用,结合深度学习和影像合成,能以逼真的方式替换或操纵现有的媒体内容,以达到换脸、变声等效果,已经成为诈团骗人的新利器。

北市刑大指出,早期「深偽」的技术运用,主要用于偽造成人影,或模仿政治人物、名人进行宣传有关,但有心人可能利用它来散布假讯息、诽谤以及侵犯个人隐私,但随着该技术的取得愈发容易,应用范围逐渐扩展到其他领域,包括娱乐、新闻、社交媒体,乃至诈骗手法的精进

北市警方针对此技术进行研析,列举出下列诈欺手法:

一、电话诈骗(猜猜我是谁)

利用深偽模仿特定人物声音的功能,仿冒家人、朋友或其他知名人士的声音,以利向受害者索取金钱与个人资料。

二、视讯诈骗:

深偽技术可用于合成拟真的影片、语音,或结合视讯功能,冒充企业高层,藉此对下属发送虚假的指示,例如要求转移资金或提供机密信息。近期大陆便出现一起科技公司老板接到AI换脸诈骗视讯电话的案例,一夕间遭诈台币1873余万元的案例。

三、恐吓诈骗:

个人肖像遭诈骗集团移花接木,用以合成不雅照片,再寄送予当事人藉机恐吓勒索,今年3月便曾有多位国内知名大学教授,收到类似的合成照片与恐吓信息的骚扰。

北市刑大指出,深偽技术与诈骗手法的组合持续进化,呼吁民眾面对科技的进步带来的犯罪威胁,最重要的是保持警惕和怀疑的心态,不轻易相信或分享未经验证的内容,并审慎对待来自陌生人(甚至是亲朋好友)的请求,在浏览各式资讯时,也应检查来源的可信度,化被动为主动,确保信息真实可靠。

如接获类似的诈骗讯息,请拨打警政署165反诈骗专线或前往邻近派出所谘询,平时亦可透过追踪脸书粉丝专页「165全民防骗」及「臺北波丽士」、「反诈骗小金刚」,获取最新防诈知识。

发表意见

中时新闻网对留言系统使用者发布的文字、图片或檔案保有片面修改或移除的权利。当使用者使用本网站留言服务时,表示已详细阅读并完全了解,且同意配合下述规定:

违反上述规定者,中时新闻网有权删除留言,或者直接封锁帐号!请使用者在发言前,务必先阅读留言板规则,谢谢配合。